ソニー・ホンダモビリティが開発中の『AFEELA 1(アフィーラ・ワン)』プロトタイプのハードウェアとソフトウェアのアーキテクチャと特徴的なコックピットHMIについて、はじめて日本語で詳細な解説が行われた。

エピックゲームズジャパンが開催したUnreal Engineの自動車業界向けイベント「Build Tokyo '25 for Automotive」における、ソニー・ホンダモビリティの腰前秀成氏が登壇した講演においてのことだ。クルマ+IT/ソフトウェアという異業種連携の象徴ともいえるAFEELAの技術的な核心に、講演内容を基に解説する。

◆AFEELAが目指す『クリエイティブなエンターテインメント空間』

ソニー・ホンダモビリティが掲げるパーパスは「人とモビリティの関係を再定義する」ことである。その実現に向け、同社は3つの「A」を価値の核心に据えている。すなわち、安全・安心を基盤とする「Autonomy(進化する自律性)」、リアルとバーチャルを融合させ移動体験を拡張する「Augmentation(身体・時空間の拡張)」、そしてオープンな共創を促す「Affinity(人との協調、社会との共生)」だ。

この思想の下、AFEELAはモビリティを「Creative Entertainment Space(新たなエンターテインメント空間)」として捉え直している。これは、単に車内でコンテンツを消費するだけでなく、ユーザー自身が好みに合わせて空間をカスタマイズし、移動そのものを楽しむための『第3の場所(サードプレイス)』を提供するという考え方だ。

その実現のため、キャビンにはフロント全面に広がるパノラミックスクリーンが配置され、映画や音楽、ゲームなど、さまざまなパートナー企業によるコンテンツが提供される。また、ソニーが培ってきた立体音響技術やDolby Atmos対応のサウンドシステムにより、搭乗者に没入感を感じさせる。ユニークなのは、走行状況に応じてモーターの走行音を生成する『e-Motor Sound』による演出だ。ドライビングの昂揚感を演出し、移動をエモーショナルな体験へと昇華させるという。

AFEELAはこれまでの自動車の概念を超え、ユーザーの「感性」に訴えかける体験の創出を目指している。このビジョンを実現するための重要な鍵を握るのが、Unreal Engineを活用したソフトウェアアーキテクチャだ。

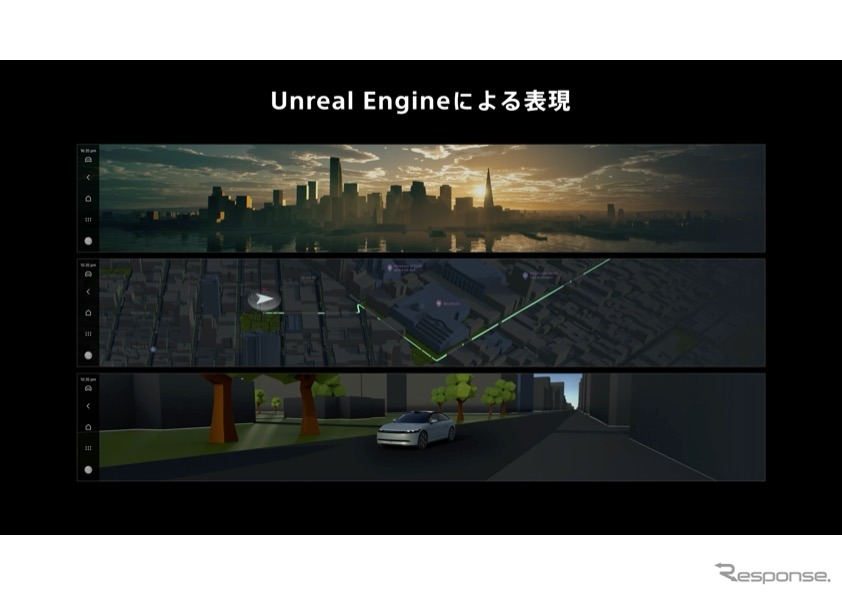

◆Unreal Engineが実現する直感的で美しいビジュアライゼーション

ゲームエンジンとして世界的に知られるUnreal Engineは、フォトリアルな3Dグラフィックスをリアルタイムに描画する能力に優れている。ソニー・ホンダモビリティは、Unreal EngineをAFEELAのコックピットUI/UX開発に全面的に採用し、従来の車載システムとは一線を画す、直感的で美しいビジュアライゼーションを実現しようとしている。

ADAS(先進運転支援システム)情報の可視化

AFEELAのドライバー正面ディスプレイには、ADASが認識している情報が3Dグラフィックスで表示される。これは、自車だけでなく、周囲の車両や歩行者、車線といった情報を、車両に搭載されたセンサー群からリアルタイムに取得し、Unreal Engineによって仮想3D空間上に再現したものだ。

これにより、ドライバーは「クルマが何を認識し、次に何をしようとしているのか」を直感的に理解できる。これは、運転支援システムへの信頼感を醸成し、安全・安心な移動体験を提供する上で極めて重要な要素である。システムが認識している情報をただアイコンや記号で示すのではなく、現実世界とリンクした3D空間として見せることで、人とクルマの間のコミュニケーションを円滑にしているのだ。

3Dマップによる新しいナビゲーション体験

従来の2Dマップや鳥瞰図的なナビゲーションとは異なり、AFEELAではUnreal Engineを用いて、都市空間そのものを3Dでダイナミックに描画する。これにより、ドライバーはまるで都市の中を飛行しているかのような視点でルートを確認でき、より直感的に地理を把握することが可能になる。

腰前氏は、この3Dマップを「単なる移動のためのツールではなく、AFEELAが提供するエンターテインメントコンテンツの一つ」と位置づけている。Unreal Engineの採用は、ナビゲーションという実用的な機能に、ゲームのような楽しさや美しさという新たな価値を付加するための戦略的な選択なのである。

◆ビジュアライゼーションを支える技術アーキテクチャ

これら高度なビジュアライゼーションは、Unreal Engineという描画エンジンだけでは実現できない。センサーやマップからの膨大なデータをリアルタイムに処理し、エンジンに渡すための洗練されたソフトウェアアーキテクチャが不可欠である。

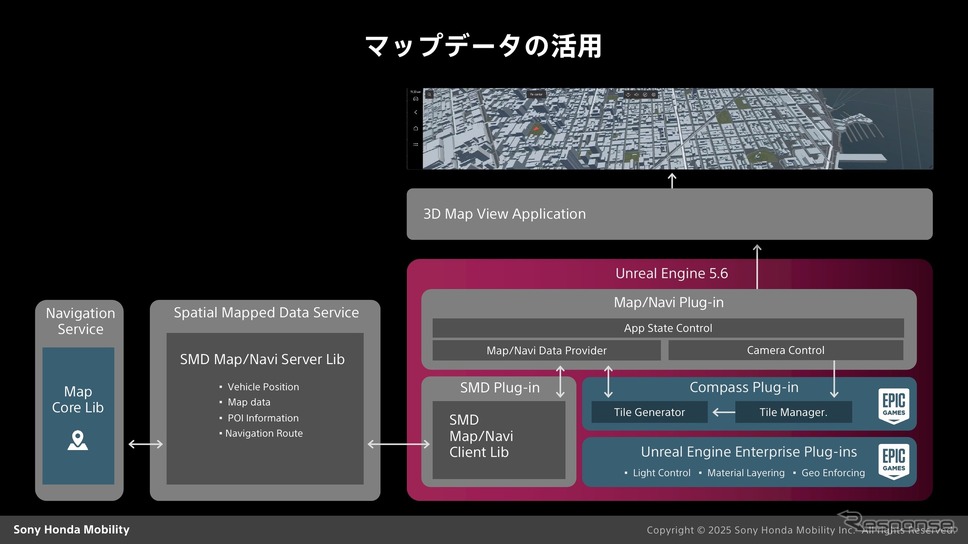

Unreal Engineを軸にした3Dマップデータの処理と描画

AFEELAの3Dマップ表示は、複数のコンポーネントが連携して実現されている。まず、「Navigation Service」が地図のコアライブラリを使い、車両位置やルート情報などを提供する。これらのデータは、講演で繰り返し登場する重要なコンポーネント「Spatial Mapped Data Service (SMD)」に送られる。

SMDで処理されたデータは、「SMD Plug-in」を介してUnreal Engine 5.6上で動作する3Dマップアプリケーションに渡される。ここでキーとなるのが、Epic Gamesとの協業で開発された「Compass Plugin」だ。このプラグインが、広大なマップデータを効率的に扱えるタイル形式に変換・管理(Tile Generator / Tile Manager)し、スムーズな3Dマップ描画を可能にしている。

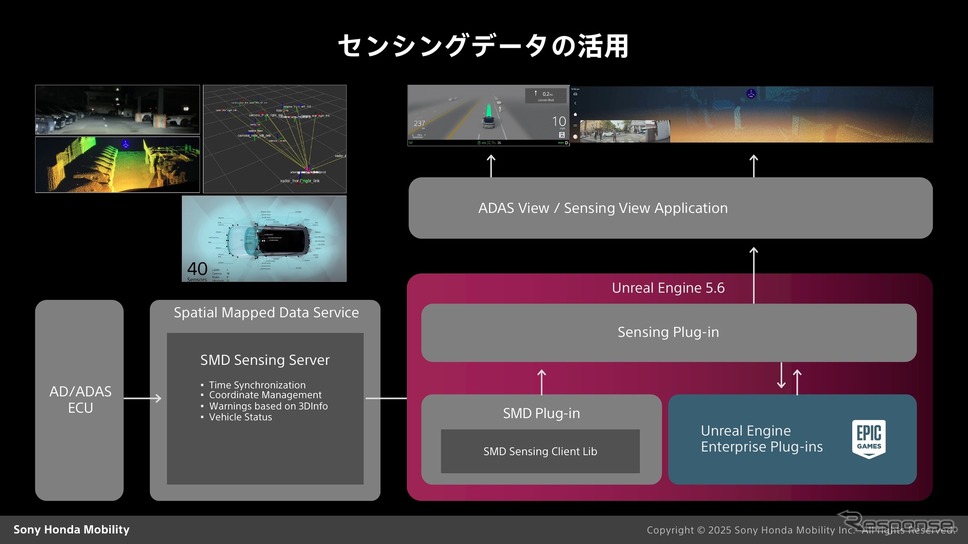

センシングデータの処理と描画

ADASのビジュアライゼーションも同様のアーキテクチャを採る。AD/ADAS用ECUから出力されるセンサーフュージョン後の認識データ(車両、歩行者など)は、SMDの「SMD Sensing Server」へと送られる。ここで、複数のセンサーからの情報を時間的・空間的に同期させ、座標管理などを行った上で、Unreal Engineへと渡される。これにより、異なるセンサーからの情報を矛盾なく一つの3D空間上に描画することが可能になるのだ。

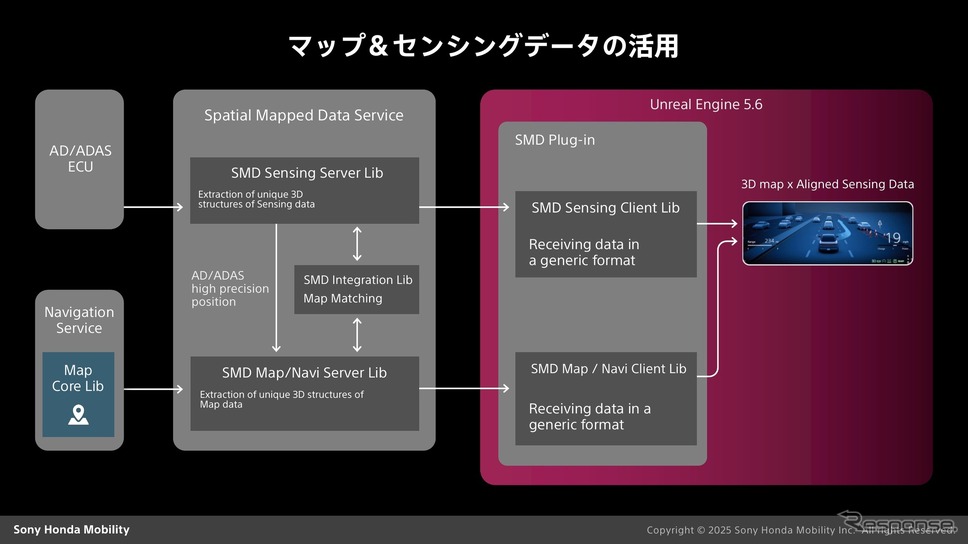

マップとセンシングデータの統合

AFEELAのアーキテクチャの真骨頂は、これらマップデータとセンシングデータを統合して扱う点にある。SMDの中核には「SMD Integration Lib」が存在し、ここでAD/ADASシステムから得られる高精度な自車位置情報を基に、リアルタイムのセンシングデータと3Dマップデータの位置合わせ(Map Matching)が行われる。

こうして生成された「3D map x Aligned Sensing Data」は、現実空間と仮想空間が完全に同期したデジタルツインともいえる情報だ。これがUnreal Engineに渡されることで、3Dマップ上に、現実世界で起きている事象(他車の動きなど)を正確に再現するリッチで直感的なUIが実現される。

◆AFEELAを支える先進技術とE/Eアーキテクチャ

これらのSF映画のようなビジュアライゼーションを実現するために、膨大な情報を処理するための強力なハードウェアと、それらを効率的に連携させるための「E/Eアーキテクチャ(車両の電子・電気設計思想)」が存在する。ここでは、AFEELAの体験を根底から支える物理的な基盤を見ていこう。

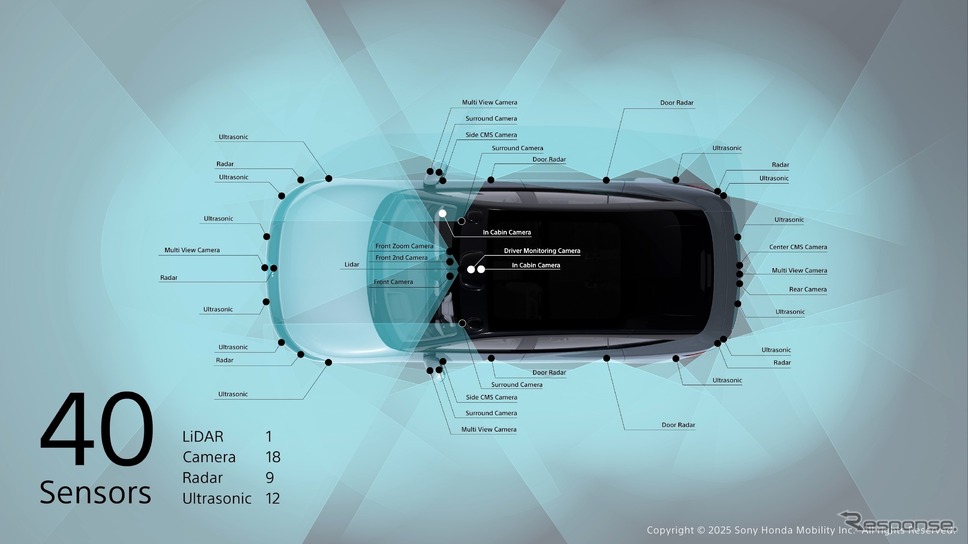

高度なセンシング技術(センサー構成)

AFEELAの「眼」となるのは、車両の全周囲360度を監視するために搭載された合計40個ものセンサー群である。その内訳は、レーザー光で遠方の物体との正確な距離を測る「LiDAR」が1個、物体の色や形を認識する「カメラ」が車内外に18個、雨や霧などの悪天候下でも安定して物体を検知できる「レーダー」が9個、そして近距離の障害物検知に用いる「超音波センサー」が12個となっている 。

これらの多種多様なセンサーからの情報を統合的に処理(センサーフュージョン)することで、単一のセンサーでは見誤る可能性のある状況でも、システムの認識精度を高めることで、安全性を担保している。

![ホンダ、電動バイク『ベンリィe: I』など10車種2万3907台リコール[新聞ウォッチ]](/imgs/sq_m_l1/2204327.jpg)